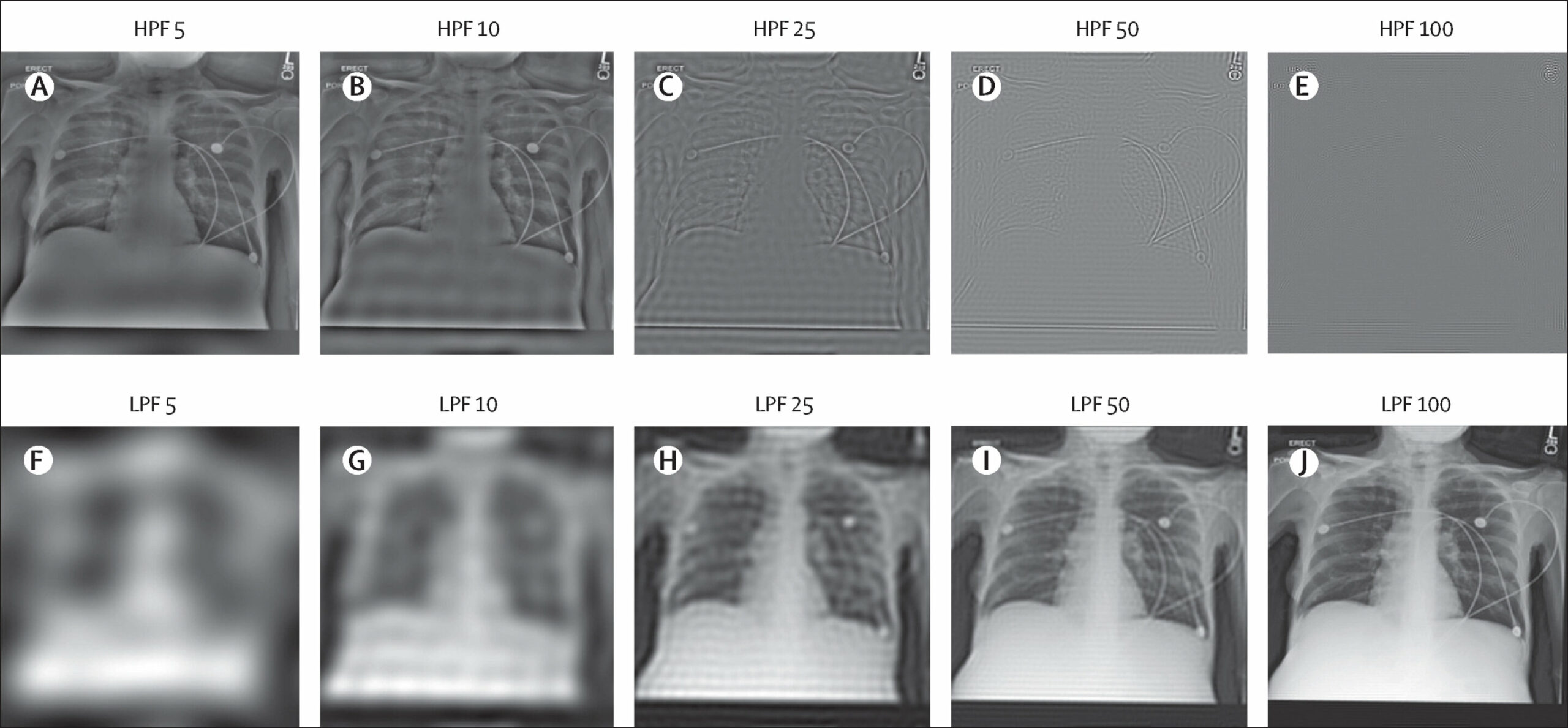

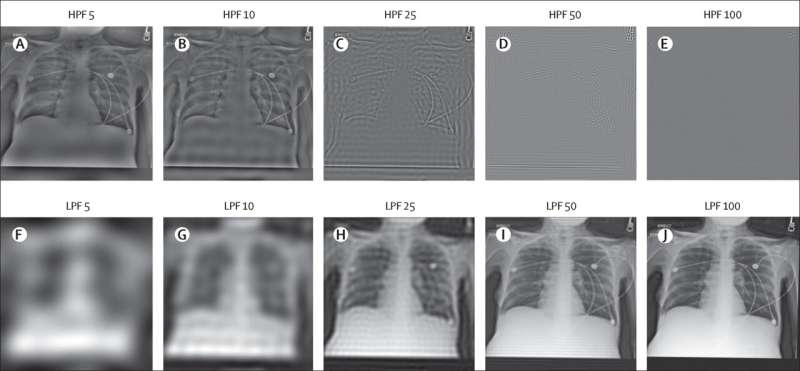

Muestras de imágenes después de filtros de paso bajo y filtros de paso alto en el conjunto de datos MXR. HPF = filtrado de paso alto. LPF = filtrado de paso bajo. MXR=Conjunto de datos MIMIC-CXR. Crédito: La salud digital de Lancet (2022). DOI: 10.1016/S2589-7500(22)00063-2

La inteligencia artificial (IA) se utiliza en una amplia variedad de entornos de atención médica, desde el análisis de imágenes médicas hasta la asistencia en procedimientos quirúrgicos. Si bien la IA a veces puede superar a los médicos capacitados, estas habilidades sobrehumanas no siempre se comprenden por completo.

En un estudio reciente publicado en La salud digital de Lancet, los investigadores descubrieron que los modelos de IA podían predecir con precisión la raza autoinformada en varios tipos diferentes de imágenes radiográficas, una tarea que no es posible para los expertos humanos. Estos hallazgos sugieren que la información racial podría incorporarse sin saberlo en los modelos de análisis de imágenes, lo que podría exacerbar las disparidades raciales en el entorno médico.

«La IA tiene un inmenso potencial para revolucionar el diagnóstico, el tratamiento y el seguimiento de numerosas enfermedades y afecciones, y podría moldear drásticamente la forma en que abordamos la atención de la salud», dijo Judy Gichoya, primera autora del estudio y becaria del Servicio Nacional de Avance de Datos y Tecnología (DATA) del NIBIB. , MD «Sin embargo, para que la IA realmente beneficie a todos los pacientes, necesitamos una mejor comprensión de cómo estos algoritmos toman sus decisiones para evitar sesgos no deseados».

El concepto de sesgo en los algoritmos de IA no es nuevo. Estudios de investigación han demostrado que el rendimiento de la IA puede verse afectado por las características demográficas, incluida la raza. Existen varios factores potenciales que podrían generar sesgos en los algoritmos de IA, como el uso de conjuntos de datos que no son representativos de una población de pacientes (p. ej., el uso de conjuntos de datos en los que la mayoría de los pacientes son blancos). Además, los factores de confusión (rasgos o fenotipos que están desproporcionadamente presentes en las poblaciones de subgrupos (como las diferencias raciales en la densidad mamaria o ósea)) también pueden introducir sesgos. El estudio actual destaca otro factor potencial que podría introducir sesgos no deseados en los algoritmos de IA.

Para su estudio, Gichoya y sus colegas primero querían determinar si podían desarrollar modelos de IA que pudieran detectar la raza únicamente a partir de radiografías de tórax. Utilizaron tres grandes conjuntos de datos que abarcaban una población diversa de pacientes y descubrieron que sus modelos podían predecir la raza con gran precisión, un hallazgo sorprendente, ya que los expertos humanos no pueden hacer tales predicciones observando radiografías. Los investigadores también descubrieron que la IA podía determinar la raza autoinformada incluso cuando las imágenes estaban muy degradadas o recortadas a una novena parte del tamaño original, o cuando la resolución se modificaba hasta tal punto que las imágenes apenas se reconocían como X- rayos Posteriormente, el equipo de investigación utilizó otros conjuntos de datos que no son de rayos X de tórax, incluidas mamografías, radiografías de la columna cervical y tomografías computarizadas (TC) de tórax, y descubrió que la IA aún podía determinar la raza autoinformada, independientemente del tipo de exploración o anatomía. ubicación.

«Nuestros resultados sugieren que hay ‘señales ocultas’ en las imágenes médicas que llevan a la IA a predecir la raza», dijo Gichoya. «Necesitamos acelerar nuestra comprensión de por qué estos algoritmos tienen esta capacidad, de modo que las aplicaciones posteriores de la IA, como la creación de algoritmos basados en imágenes para hacer predicciones sobre la salud, no sean potencialmente dañinas para las poblaciones de pacientes minoritarios y desatendidos».

Los investigadores intentaron comprender cómo la IA pudo hacer estas predicciones. Analizaron una variedad de factores de confusión diferentes que podrían afectar potencialmente las características de las imágenes radiográficas, como el índice de masa corporal (IMC), la densidad mamaria, la densidad ósea o la distribución de la enfermedad. No pudieron identificar ningún factor específico que pudiera explicar la capacidad de la IA para predecir con precisión la raza autoinformada. En resumen, si bien la IA puede entrenarse para predecir la raza a partir de imágenes médicas, aún no se ha descubierto la información que utilizan los modelos para hacer estas predicciones.

«Ha habido una línea de pensamiento de que si los desarrolladores ‘ocultan’ los factores demográficos, como la raza, el género o el nivel socioeconómico, del modelo de IA, el algoritmo resultante no podrá discriminar en función de tales características y, por lo tanto, será ‘ justa.’ Este trabajo destaca que esta visión simplista no es una opción viable para garantizar la equidad en la IA y el aprendizaje automático», dijo Rui Sá, Ph.D., becario de NIBIB DATA. «Necesitamos reconocer las posibles limitaciones de la IA y adaptar nuestras metodologías para garantizar que la IA sea justa para todos».

La inteligencia artificial predice la raza de los pacientes a partir de sus imágenes médicas

Judy Wawira Gichoya et al, Reconocimiento de IA de la raza del paciente en imágenes médicas: un estudio de modelado, La salud digital de Lancet (2022). DOI: 10.1016/S2589-7500(22)00063-2

Proporcionado por el Instituto Nacional de Imágenes Biomédicas y Bioingeniería

Citación: Un estudio encuentra que la inteligencia artificial puede determinar la raza a partir de imágenes médicas (19 de octubre de 2022) consultado el 19 de octubre de 2022 en https://medicalxpress.com/news/2022-10-artificial-intelligence-medical-images.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.