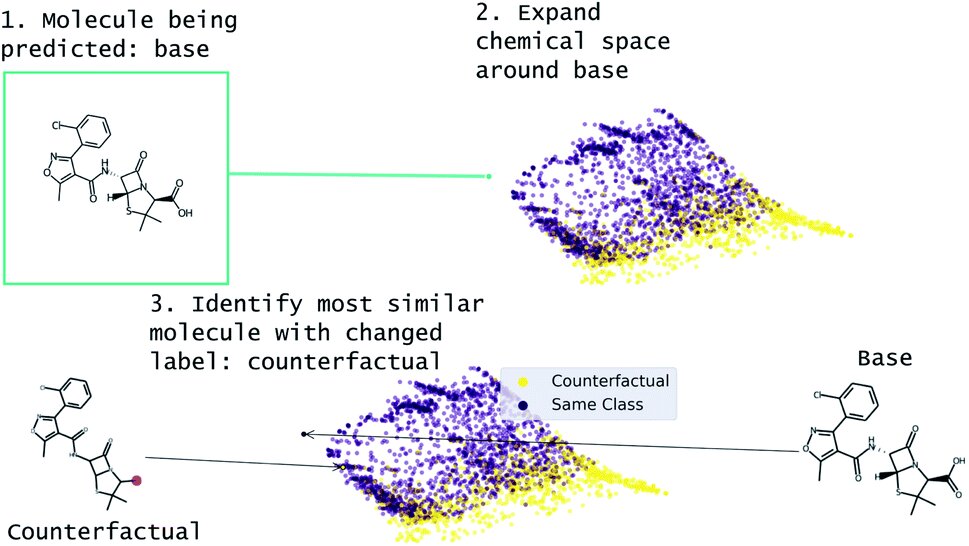

Descripción general de MMACE. La entrada es una molécula a predecir. El espacio químico se expande y se agrupa. Los contrafactuales se seleccionan de grupos para encontrar una explicación sucinta de la predicción de la molécula base. Crédito: ciencia química (2022). DOI: 10.1039/D1SC05259D

Los científicos confían cada vez más en modelos entrenados con aprendizaje automático para brindar soluciones a problemas complejos. Pero, ¿cómo sabemos que las soluciones son confiables cuando los algoritmos complejos que usan los modelos no son fáciles de interrogar o no pueden explicar sus decisiones a los humanos?

Esa confianza es especialmente crucial en el descubrimiento de fármacos, por ejemplo, donde el aprendizaje automático se utiliza para clasificar millones de compuestos potencialmente tóxicos para determinar cuáles podrían ser candidatos seguros para fármacos.

«Ha habido algunos accidentes de alto perfil en informática en los que un modelo podía predecir cosas bastante bien, pero las predicciones no se basaban en nada significativo», dice Andrew White, profesor asociado de ingeniería química en la Universidad de Rochester, en una entrevista. con el Mundo de la Química.

White y su laboratorio han desarrollado un nuevo método «contrafactual», descrito en ciencia químicaque se puede usar con cualquier modelo de aprendizaje automático basado en estructuras moleculares para comprender mejor cómo el modelo llegó a una conclusión.

Los contrafactuales pueden decirles a los investigadores «el cambio más pequeño en las características que alteraría la predicción», dice el autor principal Geemi Wellawatte, Ph.D. estudiante en el laboratorio de White. «En otras palabras, un contrafactual es un ejemplo tan cercano al original, pero con un resultado diferente».

Los contrafactuales pueden ayudar a los investigadores a identificar rápidamente por qué un modelo hizo una predicción y si es válida.

El documento identifica tres ejemplos de cómo el nuevo método, llamado MMACE (Molecular Model Agonistic Counterfactual Explanations), puede usarse para explicar por qué:

- se predice que una molécula penetrará la barrera hematoencefálica

- se predice que una molécula pequeña es soluble

- se predice que una molécula inhibe el VIH

El laboratorio tuvo que superar algunos desafíos importantes en el desarrollo de MMACE. Necesitaban un método que pudiera adaptarse a la amplia gama de métodos de aprendizaje automático que se utilizan en química. Además, buscar la molécula más similar para cualquier escenario dado también fue un desafío debido a la gran cantidad de posibles moléculas candidatas.

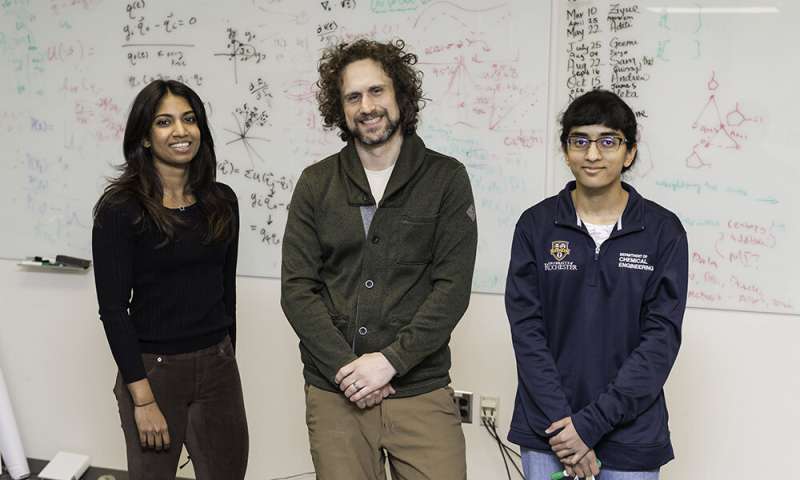

Desde la izquierda: la estudiante de doctorado Geemi Wellawatte, Andrew White, profesor asociado de ingeniería química y Aditi Seshadri ’22 en Wegmans Hall. El laboratorio de White ha desarrollado una forma de verificar las predicciones de los modelos de aprendizaje automático utilizados en el descubrimiento de fármacos mediante el uso de contrafactuales. Crédito: Universidad de Rochester/J. adam fenster

La coautora Aditi Seshadri en el laboratorio de White ayudó a resolver ese problema al sugerir que el grupo adaptara el algoritmo STONED (superrápido recorrido, optimización, novedad, exploración y descubrimiento) desarrollado en la Universidad de Toronto. STONED genera eficientemente moléculas similares, el combustible para la generación contrafáctica. Seshadri es investigadora de pregrado en el laboratorio de White y pudo ayudar en el proyecto a través de un programa de investigación de verano de Rochester llamado «Discover».

White dice que su equipo continúa mejorando MMACE, probando otras bases de datos en su búsqueda de moléculas más similares, por ejemplo, y refinando la definición de similitud molecular.

Geemi P. Wellawatte et al, Modelo de generación agnóstica de explicaciones contrafactuales para moléculas, ciencia química (2022). DOI: 10.1039/D1SC05259D

Citación: Uso de ‘contrafactuales’ para verificar las predicciones de seguridad de los medicamentos (2 de mayo de 2022) recuperado el 2 de mayo de 2022 de https://phys.org/news/2022-05-counterfactuals-drug-safety.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.