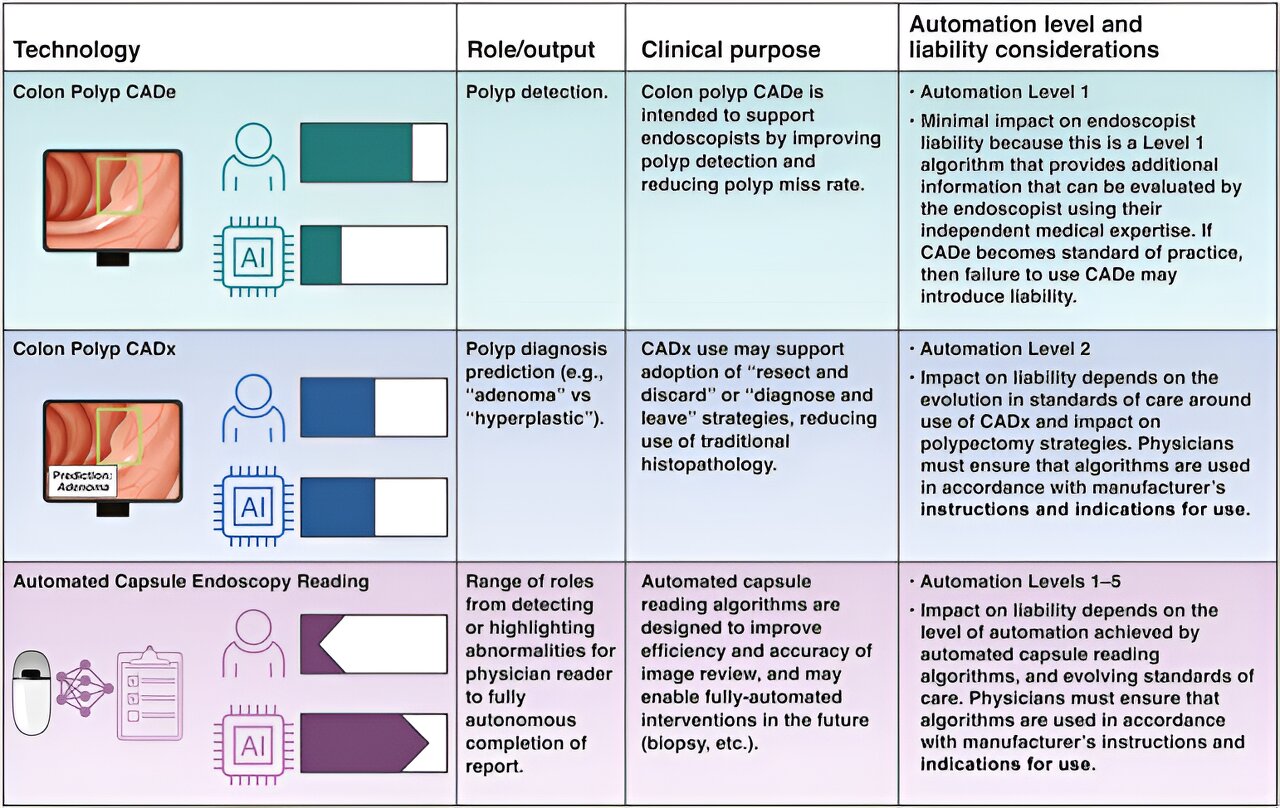

Niveles de automatización y consideraciones de responsabilidad para herramientas de inteligencia artificial representativas en endoscopia gastrointestinal. Crédito: Danielle Duffey

En el ámbito de la endoscopia gastrointestinal (GI), la inteligencia artificial (IA) se está convirtiendo en una herramienta esencial, especialmente en la detección asistida por computadora de pólipos precancerosos del colon durante la colonoscopia de detección. Esta integración marca un avance significativo en la atención de gastroenterología. Sin embargo, la inevitabilidad de los errores persiste y, en algunos casos, los propios algoritmos de IA podrían contribuir a los errores médicos.

Para abordar esto, los médicos-científicos del Centro de Endoscopia Avanzada del Centro Médico Beth Israel Deaconess (BIDMC), en colaboración con expertos legales de la Universidad Estatal de Pensilvania y la Universidad de Maastricht, están siendo pioneros en esfuerzos para desarrollar directrices sobre responsabilidad médica por el uso de IA en el sistema gastrointestinal. endoscopia.

Un artículo reciente, dirigido por los gastroenterólogos del BIDMC Sami Elamin, MD, y Tyler Berzin, MD, y publicado en Gastroenterología Clínica y Hepatología, representa el primer esfuerzo internacional para explorar las implicaciones legales de la IA en la endoscopia gastrointestinal desde la perspectiva tanto de gastroenterólogos como de juristas. Berzin, endoscopista avanzado del BIDMC y profesor asociado de medicina en la Facultad de Medicina de Harvard, ha dirigido varios de los primeros estudios nacionales e internacionales que exploran el papel de la IA para la detección de pólipos precancerosos del colon, un algoritmo de asistencia de «nivel 1».

Sin embargo, las herramientas de inteligencia artificial pronto están preparadas para avanzar más allá de la simple detección de pólipos y pronto podrían desempeñar un papel en la predicción del diagnóstico de pólipos, reemplazando potencialmente la necesidad de una biopsia de tejido en ciertos casos. Los autores sugieren que niveles aún más altos de automatización son técnicamente factibles e inminentes, lo que podría proporcionar a los médicos asistentes informes y recomendaciones de endoscopia automatizados.

El autor principal, Elamin, miembro clínico de Gastroenterología en BIDMC y la Facultad de Medicina de Harvard, utilizó escenarios hipotéticos para explorar la posible responsabilidad legal de médicos individuales u organizaciones de atención médica por una variedad de posibles errores generados por la IA que podrían ocurrir en el campo de la endoscopia gastrointestinal. .

El grado de responsabilidad legal por los errores de la IA, concluyen los autores, dependerá de cómo se integren estas herramientas en la práctica clínica y del nivel de automatización de los algoritmos. Para garantizar la seguridad, la implementación adecuada y el seguimiento de estas herramientas de IA, la colaboración entre hospitales, grupos médicos y gastroenterólogos es crucial. Las sociedades especializadas y las organizaciones de atención médica deben establecer pautas para la supervisión médica de las herramientas de inteligencia artificial en varios niveles de automatización.

Para los médicos, la documentación clínica meticulosa (ya sea que cumplan o se desvíen de las recomendaciones de la IA) sigue siendo una piedra angular para minimizar los riesgos de responsabilidad.

Más información:

Sami Elamin et al, Inteligencia artificial y responsabilidad médica en endoscopia gastrointestinal, Gastroenterología Clínica y Hepatología (2024). DOI: 10.1016/j.cgh.2024.03.011

Citación: ¿Quién tiene la culpa cuando la IA comete un error médico? (23 de mayo de 2024) obtenido el 23 de mayo de 2024 de https://medicalxpress.com/news/2024-05-blame-ai-medical-error.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.